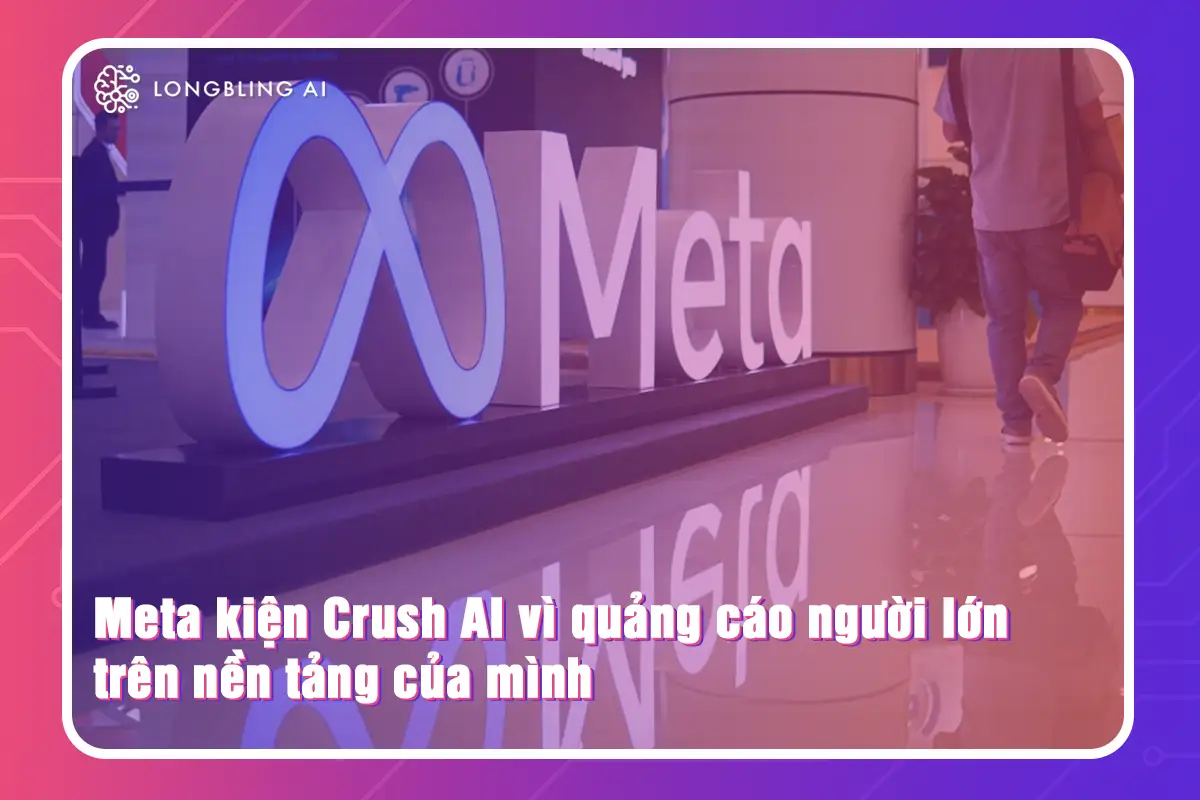

Trong một động thái quyết liệt, Meta (công ty mẹ của Facebook và Instagram) đã đệ đơn kiện Joy Timeline HK, đơn vị đứng sau ứng dụng Crush AI một công cụ AI chuyên tạo ảnh khỏa thân giả mạo (còn gọi là nudif) vì đã chạy hàng nghìn quảng cáo vi phạm chính sách trên nền tảng của Meta.

Theo thông tin từ Meta, vụ kiện được nộp tại Hồng Kông, đánh dấu một bước leo thang pháp lý chưa từng có trong nỗ lực chống lại việc khai thác AI vào mục đích khiêu dâm và xâm phạm quyền riêng tư cá nhân.

Nude AI là gì và tại sao lại nguy hiểm?

Crush AI là một ứng dụng sử dụng công nghệ AI tạo sinh (Generative AI) để tạo ra hình ảnh khỏa thân giả của người thật, thường là không có sự đồng ý của họ. Dù không chứa hình ảnh thật, nhưng sản phẩm cuối cùng được thiết kế để đánh lừa người xem, làm tổn hại nghiêm trọng đến danh dự và quyền cá nhân.

Theo báo cáo của Alexios Mantzarlis, tác giả chuyên theo dõi nội dung giả mạo, chỉ trong hai tuần đầu năm 2025, Crush AI đã chạy hơn 8.000 quảng cáo trên Facebook và Instagram, chủ yếu dưới dạng các trang hoặc tài khoản có tên như Eraser Anyone’s Clothes.

Meta phản ứng ra sao?

Dù Meta đã liên tục gỡ bỏ các quảng cáo vi phạm, đơn vị đứng sau Crush AI vẫn lách luật bằng cách:

- Tạo hàng chục tài khoản quảng cáo khác nhau

- Thay đổi tên miền thường xuyên

- Ẩn nội dung thật trong trang đích để qua mặt hệ thống kiểm duyệt

Trước tình trạng này, Meta không chỉ khởi kiện, mà còn nâng cấp hệ thống phát hiện quảng cáo AI nudify, bao gồm:

- Công nghệ nhận diện ngữ cảnh phi trực tiếp: phát hiện quảng cáo dù không có hình ảnh nude.

- Mở rộng danh sách từ khóa, biểu tượng cảm xúc vi phạm

- Áp dụng công nghệ matching & anti-abuse network tracking: vốn dùng để đánh sập các mạng bot, giờ được mở rộng sang các mạng AI nudify.

Tính đến giữa năm 2025, Meta đã triệt phá 4 mạng lưới quảng cáo kiểu này.

Cuộc chiến không chỉ diễn ra tại Meta

Hiện tượng nude AI không chỉ xuất hiện trên Facebook hay Instagram. Theo nhiều nhóm nghiên cứu: X (Twitter), Reddit, YouTube và Telegram đều từng bị lợi dụng để phát tán hoặc quảng cáo dịch vụ nudify. Trên YouTube, hàng triệu lượt xem đã tiếp cận các mẫu quảng cáo dạng này dù không chứa hình ảnh nhạy cảm rõ ràng.

Meta có thể làm gì tiếp theo?

Về mặt công nghệ:

- Hợp tác với các tập đoàn lớn thông qua chương trình Lantern thuộc Tech Coalition (Meta, Google, Snap…) để chia sẻ URL và thuật toán chặn các nền tảng nudify.

- Tăng cường công cụ AI chủ động kiểm duyệt hình ảnh nhạy cảm hoặc nghi ngờ là sản phẩm deepfake.

Về mặt chính sách:

- Ủng hộ luật kiểm soát tải app cho trẻ vị thành niên, điển hình là Đạo luật Take It Down tại Hoa Kỳ – cho phép cha mẹ kiểm duyệt những gì con họ được phép tải.

Bản thân là người đào tạo và phổ cập kiến thức về AI, tôi cho rằng: AI không sai, sai là cách người ta dùng AI. Vụ kiện này không đơn thuần là hành động pháp lý, mà là lời cảnh báo mạnh mẽ rằng: việc phát triển AI không đi cùng đạo đức và kiểm soát sẽ gây ra hậu quả không thể đảo ngược

Vụ kiện giữa Meta và Crush AI là minh chứng rõ ràng cho việc các nền tảng mạng xã hội lớn đang phải đối mặt với hậu quả từ chính công nghệ mà họ góp phần tạo ra. Dù Meta đã và đang triển khai các biện pháp kỹ thuật, vẫn còn một khoảng trống lớn về giáo dục và pháp luật, nhất là ở các quốc gia chưa có khung quy định rõ ràng với nội dung AI giả mạo nhạy cảm.

Nếu bạn đang làm nội dung số, vận hành hệ thống AI hoặc đơn giản là quan tâm đến vấn đề đạo đức trong công nghệ hãy xem vụ việc này như một bài học sống động, để từ đó sử dụng AI một cách an toàn văn minh và có trách nhiệm.